动作控制

Somake 动作控制利用 AI 技术将视频动作精准迁移至静态图片。轻松制作跳舞数字人、动画吉祥物和各类角色驱动内容,实现专业级的动态转换效果。

示例

支持 MP4、MOV、WEBM 格式(最大 20 MB), 时长 3-30 秒, 每边 340-3850px 像素

0/2000

设置

画面比例

保留音频

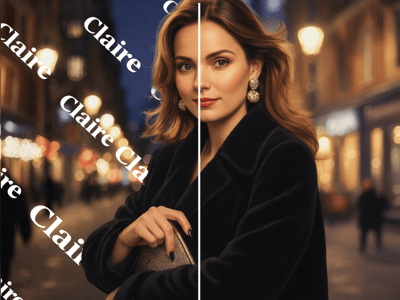

利用 AI 将视频动作迁移至任意图片

通过提取参考素材中的动作并将其应用到你的角色上,将静态图片转化为流畅的视频。上传一张照片,选择一段动作视频,只需几分钟即可生成专业级的视频内容。

动作控制使用教程

1. 准备素材

角色图片:建议正面视角

参考视频:3-10 秒时长,画面中仅有一人且背景简洁

2. 选择 AI 模型

3. 开始生成

上传文件,根据需要添加场景提示词,点击“生成”即可。处理过程通常需要 3-5 分钟。

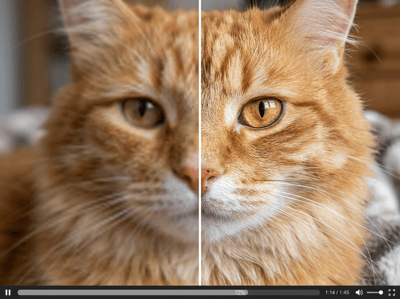

精准手部追踪

能够准确捕获手部动作、手指位置和各种手势——完美解决了早期 AI 视频工具中常见的“手指错乱”问题。

最佳应用场景

规模化营销内容产出

仅需一次动作捕捉,即可生成数十种创意版本:不同的虚拟主持人、针对不同市场的本土化角色或多种艺术风格。无需重复拍摄,即可展示产品在不同体型角色身上的动态效果。

更具吸引力的教育内容

将讲师的动作迁移至动画角色上,提升学生的注意力。语言老师可以结合手势演示发音,健身教练可以制作带有动画引导的训练视频。原始的节奏和动作将完美还原至最终成果中。

角色驱动的社交媒体内容

记录一段你跳热门舞蹈的视频,然后将动作迁移到插画头像或吉祥物上。无需真人出镜,围绕虚拟 IP 建立个人品牌。一个参考视频即可生成多个角色版本,适配不同发布平台。

为什么选择 Somake

1

结果可预期

不再需要“碰运气”,每一生成都能产出稳定可用的 AI 视频。

2

高效省时

动画制作不再需要耗费数小时,现在只需几分钟即可达到广播级水准。

3

极低的技术门槛

无需专业设备或深厚的技术背景,即可使用专业级的动作迁移技术。