Cos'è HappyHorse-1.0? Il misterioso modello AI video che ha appena scalato tutte le classifiche

Ultimo aggiornamento: aprile 2026

Un modello che nessuno si aspettava ha appena conquistato il primo posto in tutte e quattro le classifiche di generazione video monitorate da Artificial Analysis, la piattaforma di valutazione indipendente più autorevole per i video AI.

Il suo nome è HappyHorse-1.0.

Non arriva da Google. Nemmeno da OpenAI o ByteDance. Nasce da un laboratorio indipendente nato all'interno di un colosso dell'e-commerce.

Ecco cosa scoprirai in questo articolo in circa 8 minuti: un quadro chiaro su cosa sia effettivamente HappyHorse-1.0, chi lo ha creato, come si comporta esattamente rispetto ai principali competitor (con tabelle comparative complete), cosa non sappiamo ancora e cosa significa tutto questo se lavori con i video AI.

Iniziamo.

HappyHorse-1.0 in sintesi

HappyHorse-1.0 è un modello di generazione video AI che supporta:

Sintesi Text-to-video (da testo a video)

Sintesi Image-to-video (da immagine a video)

Generazione audio integrata

Rilasciato ad aprile 2026, ha ottenuto immediatamente il primato in ogni classifica video di Artificial Analysis: un traguardo mai raggiunto prima da un singolo modello.

Ciò che lo rende speciale non è una singola funzione spettacolare, ma la sua costanza: HappyHorse-1.0 supera i modelli di ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) e altri, su più tipologie di task contemporaneamente.

Una piccola precisazione: Essere in cima alle classifiche non rende automaticamente un modello lo strumento migliore per ogni flusso di lavoro. I benchmark misurano la preferenza umana in confronti diretti controllati. Non misurano l'uptime delle API, i prezzi o l'affidabilità nei casi limite. Tuttavia, quando un modello guida tutte e quattro le classifiche su oltre 31.000 campioni di valutazione, non è più un caso. È un segnale che vale la pena approfondire.

Al momento, l'API è indicata come "In arrivo": non c'è ancora un accesso pubblico.

Chi ha creato HappyHorse-1.0?

Ecco la parte che ha colto di sorpresa la comunità AI.

Ti aspetteresti che il miglior modello video al mondo arrivi da un laboratorio di ricerca AI puro e iper-finanziato. Invece, HappyHorse-1.0 è stato costruito da un team guidato da Zhang Di, che inizialmente operava all'interno del Future Life Lab del Gruppo Taotian.

Cos'è il Gruppo Taotian? È l'entità dietro Taobao e Tmall, le principali piattaforme di e-commerce di Alibaba. Il Future Life Lab è nato sotto la ATH-AI Innovation Division, un'unità di ricerca e sviluppo interna, ed è poi diventato una realtà indipendente.

Quindi è solo il "modello video di Alibaba" con un altro nome?

Non proprio. Il team si è separato dall'organizzazione madre. Ma le loro radici contano: anni di accesso a infrastrutture su scala Alibaba, pipeline di dati e talenti ingegneristici hanno chiaramente fornito le basi per costruire qualcosa di questo livello.

È un trend da seguire. Nell'AI, i nuovi attori più dirompenti spesso non sono quelli con il maggior numero di ricercatori, ma quelli con la migliore ingegneria applicata: team abituati a lanciare prodotti su larga scala che portano quel rigore nello sviluppo dei modelli.

Pensala così: Google DeepMind ha oltre 1.000 ricercatori. Ma un team focalizzato di circa 50 ingegneri che ha costruito sistemi di raccomandazione in tempo reale per un miliardo di utenti? Loro capiscono l'ottimizzazione, l'infrastruttura e l'affidabilità a un livello che i laboratori di ricerca pura a volte non raggiungono.

I Benchmark: analisi completa delle prestazioni

Vediamo ora cosa è successo effettivamente nelle classifiche. Questi sono i dati che hanno reso impossibile ignorare HappyHorse-1.0.

Le classifiche qui sotto provengono da Artificial Analysis (aprile 2026). I punteggi si basano sul sistema ELO, il che significa che derivano da confronti diretti basati sulla preferenza umana: persone reali che guardano i video generati fianco a fianco e scelgono il migliore.

1. Text-to-Video (Senza Audio)

| Posizione | Modello | Creatore | Punteggio ELO | Campioni |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.379 | 8.819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.273 | 8.426 |

| 3 | SkyReels V4 | Skywork AI | 1.245 | 5.956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1.242 | 5.390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.230 | 4.879 |

Distacco dal 2° posto: +106 punti ELO.

Quanto è grande questo distacco? In termini di ELO scacchistico, 100 punti sono all'incirca la differenza tra un forte giocatore di circolo e un competitore di livello nazionale. Non è un caso: è un salto di categoria.

2. Image-to-Video (Senza Audio)

| Posizione | Modello | Creatore | Punteggio ELO | Campioni |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.413 | 9.056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.356 | 4.656 |

| 3 | grok-imagine-video | xAI | 1.332 | 6.299 |

| 4 | PixVerse V6 | PixVerse | 1.318 | 9.441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.298 | 4.741 |

Distacco dal 2° posto: +57 punti ELO.

Questo è il punteggio assoluto più alto di HappyHorse-1.0 (1.413) tra tutte le categorie. L'Image-to-video è spesso il banco di prova dove i modelli rivelano debolezze: mantenere la coerenza del movimento rispettando l'immagine originale è tecnicamente molto complesso. Un punteggio elevato qui suggerisce una solida comprensione spaziale.

3. Text-to-Video (Con Audio)

| Posizione | Modello | Creatore | Punteggio ELO | Campioni |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.225 | 6.684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.222 | 7.873 |

| 3 | SkyReels V4 | Skywork AI | 1.142 | 5.226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.108 | 5.346 |

Distacco dal 2° posto: +3 punti ELO.

Sottilissimo. Questo ci dice una cosa importante: la generazione audio nativa è la nuova frontiera competitiva e nessun modello ha ancora preso il largo. Tutti i principali attori stanno convergendo qui.

4. Image-to-Video (Con Audio)

| Posizione | Modello | Creatore | Punteggio ELO | Campioni |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.162 | 6.896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.160 | 4.831 |

| 3 | SkyReels V4 | Skywork AI | 1.084 | 5.524 |

| 4 | Veo 3.1 Fast | 1.075 | 4.680 |

Distacco dal 2° posto: +2 punti ELO.

Un altro quasi pareggio. Ma il trend è confermato: HappyHorse-1.0 è il numero 1 in ogni categoria.

Analisi del quadro generale

Quindi, cosa ci dicono i dati nel complesso?

Nella pura qualità video (senza audio): HappyHorse-1.0 ha un vantaggio schiacciante — dai 57 ai 106 punti ELO sopra gli altri. Questa è la sua zona di forza.

Nel video con audio integrato: Il vantaggio si riduce a 2-3 punti. È un testa a testa in cui l'intero settore è ancora in fase di maturazione.

Sommando tutte e quattro le classifiche: Oltre 31.000 campioni valutati. Non è un colpo di fortuna su un piccolo set di test.

La conclusione principale dei benchmark: HappyHorse-1.0 è senza dubbio il modello più potente per la pura generazione video e rimane al vertice (anche se di poco) per i nuovi task combinati audio-video.

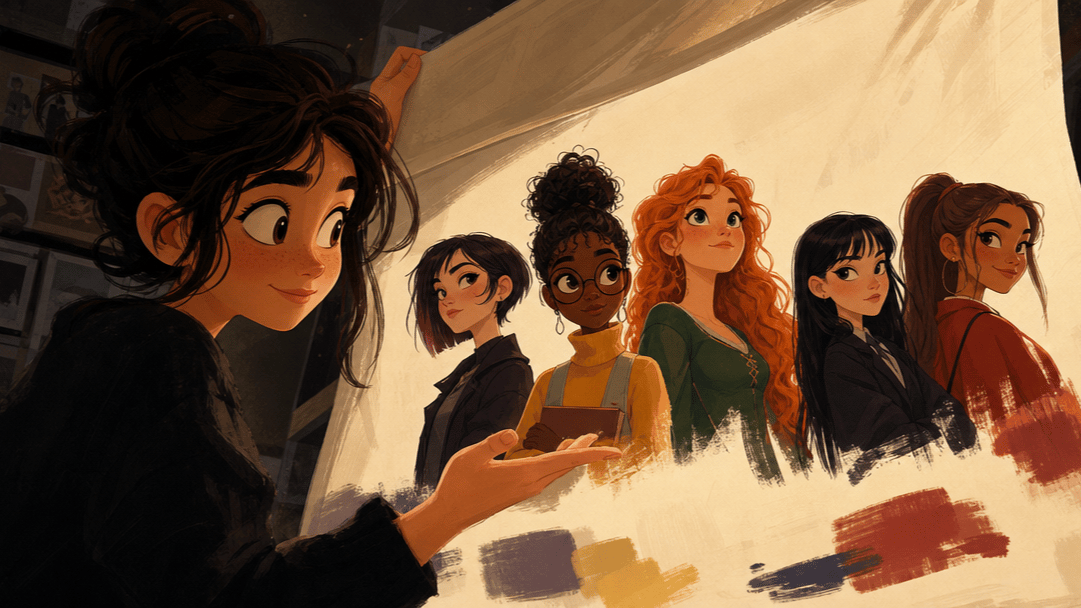

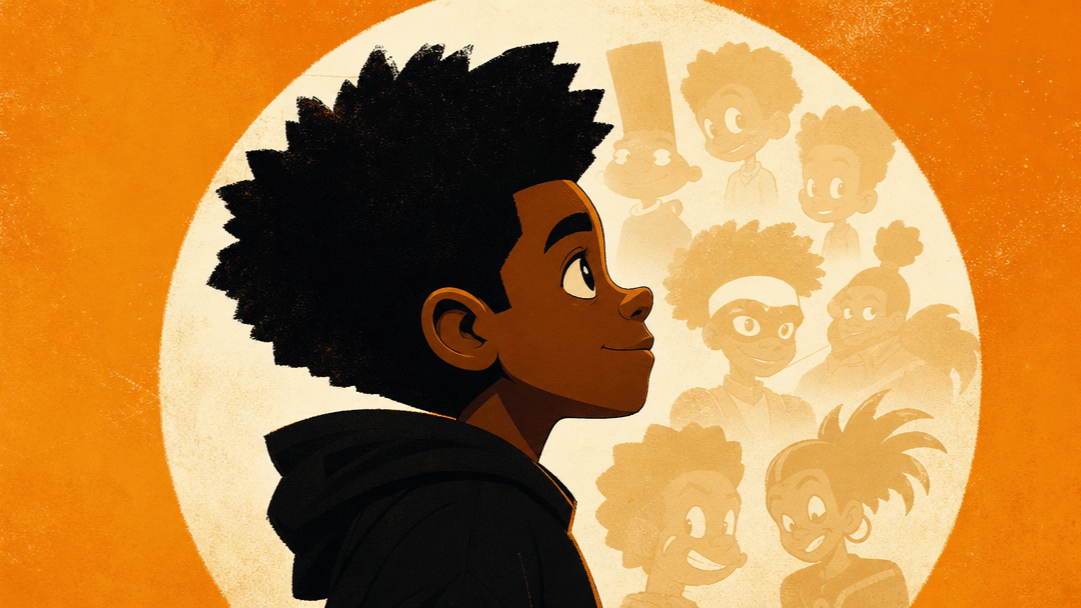

HappyHorse-1.0 in azione: galleria di esempi

Animazione di personaggi 3D

Cinematica fotorealistica

Natura e dettagli macro

Emozioni ed espressioni umane

Stili Anime e Cartoon

Lifestyle e Food

Animazione di personaggi 3D

Cinematica fotorealistica

Natura e dettagli macro

Emozioni ed espressioni umane

Stili Anime e Cartoon

Lifestyle e Food

Cosa non sappiamo ancora

I benchmark sono solo un lato della medaglia. Ecco cosa manca prima di poter definire HappyHorse-1.0 lo strumento migliore in assoluto:

Nessuna API pubblica (per ora). "In arrivo" è tutto ciò che sappiamo. Nessuna data di lancio confermata.

Nessun paper tecnico. Non sono stati pubblicati dettagli sull'architettura, sui dati di addestramento o sulla metodologia.

Specifiche di risoluzione e durata non confermate. Risoluzione massima, frame rate e lunghezza del video non sono dichiarati.

Nessun prezzo. Senza un'API attiva, i confronti dei costi con i competitor (es. SkyReels V4 a ~$7,20/min, Grok video a ~$4,20/min) sono impossibili.

Stato open-source sconosciuto. Non è presente sotto il filtro "Open weights" di Artificial Analysis.

Perché è importante: un modello che ottiene i punteggi più alti ma costa 10 volte di più o ha un uptime dell'API del 50% non dominerà l'uso reale. Le prestazioni sono fondamentali, ma non bastano. Aggiorneremo questo articolo non appena emergeranno nuovi dettagli.

Cosa ci dice HappyHorse-1.0 sul mercato dell'AI Video

Al di là del modello in sé, l'emergere di HappyHorse-1.0 ci rivela tre cose sulla direzione che sta prendendo il settore.

La frontiera non è ad uso esclusivo dei soliti noti

Google, OpenAI e ByteDance hanno i budget più grandi. Eppure, il modello video numero 1 arriva da un team nato dal laboratorio R&D di una piattaforma di shopping. Se stai costruendo in questo spazio — come startup, collaboratore open-source o team di innovazione aziendale — questo è molto incoraggiante. La porta è aperta.

L'ecosistema video AI cinese sta sorpassando gli altri

Guarda di nuovo la classifica text-to-video. Quattro dei primi cinque modelli provengono da team cinesi: HappyHorse, ByteDance Seed, Skywork AI, KlingAI. Non è un'eccezione, è un trend costante. La capacità di generazione video AI in Cina non è solo competitiva; stando ai benchmark attuali, è in testa.

L'integrazione Audio + Video è il prossimo campo di battaglia

Artificial Analysis ora monitora classifiche separate per "con audio" e "senza audio". Questa distinzione esiste perché il mercato si sta muovendo verso una generazione audiovisiva completamente integrata. Il leggero vantaggio di HappyHorse-1.0 nelle categorie audio suggerisce che sia stato progettato guardando a questo futuro multimodale, ma vale lo stesso per tutti gli altri. I distacchi cambieranno. La gara è solo all'inizio.

FAQ

Punti chiave

HappyHorse-1.0 è l'attuale modello AI video numero 1 in tutte e quattro le classifiche di Artificial Analysis (text-to-video, image-to-video, con e senza audio), valutato su oltre 31.000 campioni.

La sua dominanza è più netta nella generazione video pura (senza audio), dove guida con un vantaggio di 57–106 punti ELO. Nelle categorie con audio integrato, la concorrenza è serratissima con scarti di soli 2–3 punti.

L'origine del team è inaspettata. Creato da un gruppo nato dall'infrastruttura R&D e-commerce di Alibaba, non da un tradizionale laboratorio di ricerca AI. Questo dimostra che i team di ingegneria applicata possono competere ai massimi livelli.

Rimangono grandi incognite. Nessuna API pubblica, nessun listino prezzi, nessun paper tecnico e nessuna specifica confermata. Il primato nei benchmark non equivale ancora all'accessibilità nel mondo reale.

Da tenere d'occhio. Quando verrà lanciata l'API, i dati su costi e affidabilità determineranno se HappyHorse-1.0 diventerà uno strumento standard o resterà una curiosità statistica. Aggiorneremo l'articolo non appena ci saranno novità.

Ultimo aggiornamento: aprile 2026. Dati benchmark tratti da Artificial Analysis. Le classifiche sono dinamiche e possono variare con l'aggiunta di nuove valutazioni.