Czym jest HappyHorse-1.0? Nieznany model AI wideo, który właśnie zdominował wszystkie najważniejsze benchmarki

Ostatnia aktualizacja: kwiecień 2026

Model, którego nikt się nie spodziewał, właśnie zajął pierwsze miejsce w czterech rankingach generowania wideo monitorowanych przez Artificial Analysis — najbardziej cenioną, niezależną platformę oceniającą AI wideo.

Jego nazwa: HappyHorse-1.0.

Nie pochodzi od Google. Ani od OpenAI. Ani od ByteDance. Stworzyło go laboratorium wydzielone ze struktur giganta e-commerce.

Oto co dowiesz się z tego artykułu w około 8 minut: zyskasz jasny obraz tego, czym właściwie jest HappyHorse-1.0, kto go zbudował, jak dokładnie wypada na tle największych konkurentów (z pełnymi tabelami wyników), czego o nim jeszcze nie wiemy i co to oznacza, jeśli w jakikolwiek sposób zajmujesz się AI wideo.

Zaczynajmy.

HappyHorse-1.0 w pigułce

HappyHorse-1.0 to model AI do generowania wideo, który obsługuje:

Syntezę tekst-na-wideo (text-to-video)

Syntezę obraz-na-wideo (image-to-video)

Zintegrowane generowanie dźwięku

Został wydany w kwietniu 2026 roku i natychmiast zajął najwyższe stopnie podium we wszystkich rankingach wideo Artificial Analysis — co jest pierwszym takim przypadkiem dla pojedynczego modelu.

To, co go wyróżnia, to nie jedna efektowna funkcja, ale spójność i powtarzalność: HappyHorse-1.0 prześciga modele od ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) i innych — w wielu różnych zadaniach jednocześnie.

Szybkie wyjaśnienie: Bycie na szczycie rankingów nie czyni modelu automatycznie najlepszym narzędziem do każdego zadania. Benchmarki mierzą preferencje ludzi w kontrolowanych porównaniach bezpośrednich. Nie mierzą czasu dostępności API, cen ani niezawodności w nietypowych przypadkach. Jednak kiedy model prowadzi w czterech rankingach na podstawie ponad 31 000 próbek testowych, nie mówimy już o przypadku. To sygnał, który warto zrozumieć.

Obecnie status API to "Wkrótce dostępne" — publiczny dostęp nie został jeszcze otwarty.

Kto zbudował HappyHorse-1.0?

I tu dochodzimy do momentu, który najbardziej zaskoczył społeczność AI.

Można by oczekiwać, że najlepiej oceniany model wideo na świecie wyjdzie z świetnie sfinansowanego laboratorium badawczego skupionego wyłącznie na AI. Tymczasem HappyHorse-1.0 został stworzony przez zespół kierowany przez Zhang Di, który pierwotnie działał w ramach Future Life Lab grupy Taotian.

Czym jest Taotian Group? To podmiot stojący za Taobao i Tmall — kluczowymi platformami e-commerce koncernu Alibaba. Future Life Lab powstało w ramach ATH-AI Innovation Division, wewnętrznej jednostki badawczo-rozwojowej. Od tego czasu zespół wydzielił się jako niezależna jednostka.

Czy to po prostu "model wideo Alibaby" pod inną nazwą?

Nie do końca. Zespół odłączył się od macierzystej organizacji. Jednak ich dziedzictwo ma znaczenie: lata dostępu do infrastruktury o skali Alibaby, potężnych zbiorów danych i inżynierskich talentów stworzyły fundament pod coś na tak wysokim poziomie.

To trend, który warto obserwować. W świecie AI najbardziej rewolucyjnymi graczami często nie są ci z największą liczbą naukowców, ale ci, którzy mają najlepsze zaplecze inżynierii stosowanej — zespoły, które od lat wdrażały produkty na ogromną skalę i przenoszą tę dyscyplinę do tworzenia modeli.

Pomyśl o tym tak: Google DeepMind ma ponad 1000 badaczy. Ale skoncentrowany zespół około 50 inżynierów, którzy budowali systemy rekomendacji w czasie rzeczywistym dla miliarda użytkowników? Oni rozumieją optymalizację, infrastrukturę i niezawodność na poziomie, którego czyste laboratoria badawcze czasem nie dostrzegają.

Benchmarki: Pełne zestawienie wyników

Przyjrzyjmy się teraz temu, co faktycznie wydarzyło się w rankingach. To dane sprawiły, że HappyHorse-1.0 nie dało się zignorować.

Poniższe rankingi pochodzą z Artificial Analysis (kwiecień 2026). Wyniki oparte są na systemie ELO, co oznacza, że pochodzą z bezpośrednich porównań preferencji ludzkich — prawdziwi ludzie oglądają filmy obok siebie i wybierają lepszy.

1. Tekst-na-wideo (Bezdźwiękowe)

| Miejsce | Model | Twórca | Wynik ELO | Próbki |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 379 | 8 819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 273 | 8 426 |

| 3 | SkyReels V4 | Skywork AI | 1 245 | 5 956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1 242 | 5 390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 230 | 4 879 |

Przewaga nad 2. miejscem: +106 punktów ELO.

Jak duża to różnica? W szachach 100 punktów to mniej więcej różnica między silnym graczem klubowym a zawodnikiem na poziomie krajowym. To nie jest kwestia szczęścia — to inna liga.

2. Obraz-na-wideo (Bezdźwiękowe)

| Miejsce | Model | Twórca | Wynik ELO | Próbki |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 413 | 9 056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 356 | 4 656 |

| 3 | grok-imagine-video | xAI | 1 332 | 6 299 |

| 4 | PixVerse V6 | PixVerse | 1 318 | 9 441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 298 | 4 741 |

Przewaga nad 2. miejscem: +57 punktów ELO.

To najwyższy wynik punktowy HappyHorse-1.0 (1 413) we wszystkich kategoriach. Generowanie wideo z obrazu często obnaża słabości modeli — zachowanie spójności ruchu przy jednoczesnym poszanowaniu obrazu źródłowego jest technicznie trudne. Tak wysoki wynik sugeruje świetne zrozumienie przestrzenne.

3. Tekst-na-wideo (Z dźwiękiem)

| Miejsce | Model | Twórca | Wynik ELO | Próbki |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 225 | 6 684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 222 | 7 873 |

| 3 | SkyReels V4 | Skywork AI | 1 142 | 5 226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 108 | 5 346 |

Przewaga nad 2. miejscem: +3 punkty ELO.

Różnica minimalna. To mówi nam coś ważnego: natywne generowanie dźwięku to nowa granica konkurencji i żaden model jeszcze wyraźnie nie odskoczył od reszty. Wszyscy czołowi gracze się tu zrównują.

4. Obraz-na-wideo (Z dźwiękiem)

| Miejsce | Model | Twórca | Wynik ELO | Próbki |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 162 | 6 896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 160 | 4 831 |

| 3 | SkyReels V4 | Skywork AI | 1 084 | 5 524 |

| 4 | Veo 3.1 Fast | 1 075 | 4 680 |

Przewaga nad 2. miejscem: +2 punkty ELO.

Kolejny niemal remis. Ale wzór się powtarza: HappyHorse-1.0 jest numerem 1 w każdej kategorii.

Podsumowanie wyników

Co mówią nam te wszystkie dane?

W czystej jakości wideo (bez dźwięku): HappyHorse-1.0 ma miażdżącą przewagę — od 57 do 106 punktów ELO przed konkurencją. To jest jego najmocniejsza strona.

W wideo zintegrowanym z dźwiękiem: Przewaga maleje do 2–3 punktów. To obecnie "fotofinisz", w którym cała branża wciąż się rozwija.

Wszystkie cztery rankingi łącznie: Ponad 31 000 próbek oceniających. To nie jest przypadek na małej grupie testowej.

Kluczowy wniosek z benchmarków: HappyHorse-1.0 to zdecydowanie najsilniejszy model do generowania samego obrazu wideo i lider (choć z niewielką przewagą) w nowych zadaniach łączących obraz z dźwiękiem.

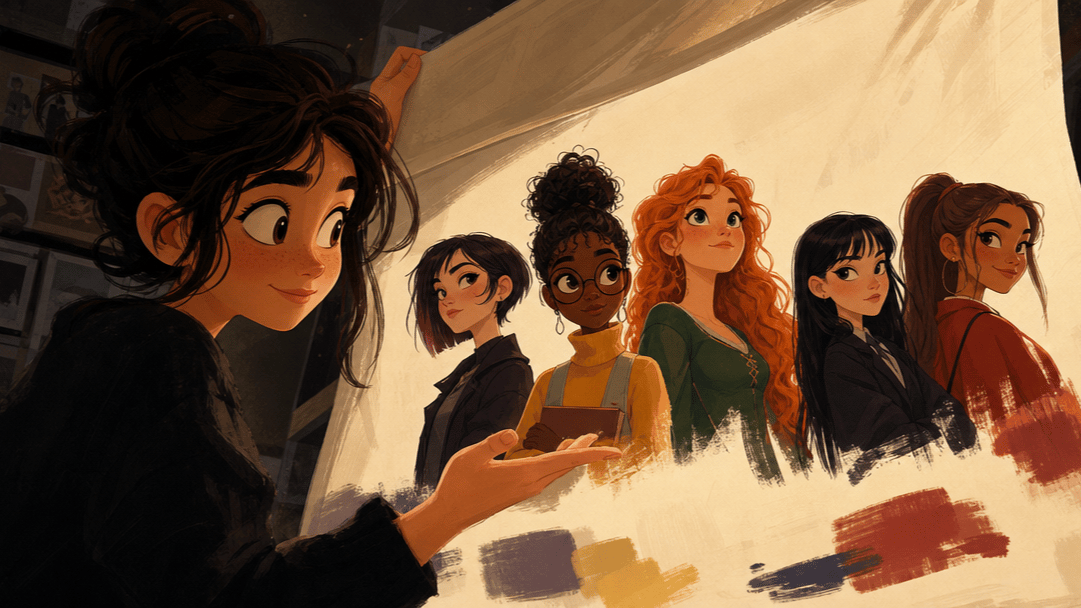

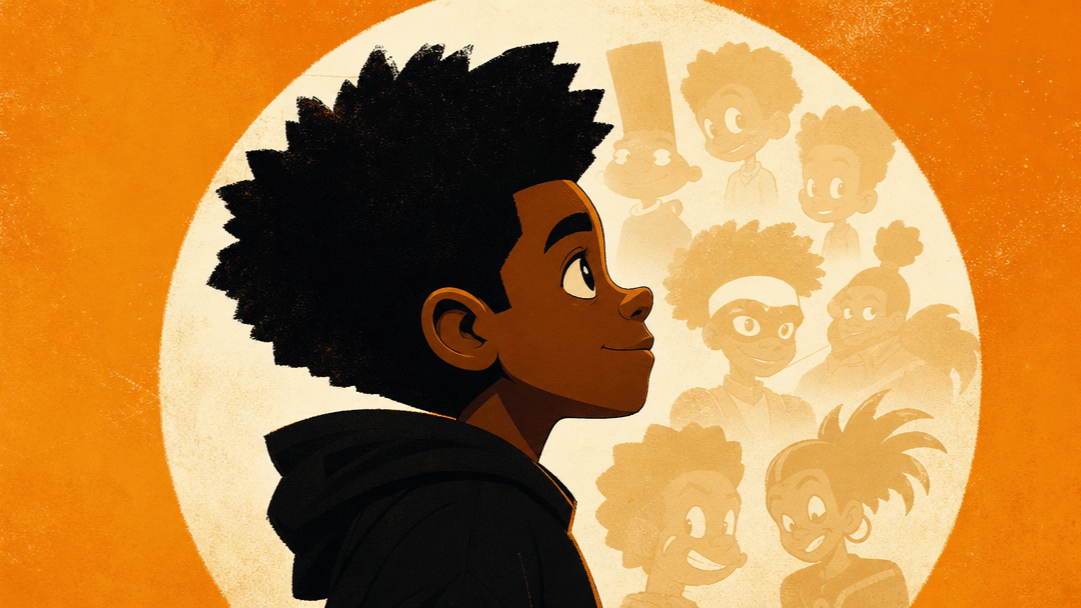

HappyHorse-1.0 w akcji: Galeria próbek

Animacja postaci 3D

Fotorealistyczne ujęcia kinowe

Przyroda i detale makro

Ludzkie emocje i mimika

Style anime i kreskówkowe

Lifestyle i jedzenie

Animacja postaci 3D

Fotorealistyczne ujęcia kinowe

Przyroda i detale makro

Ludzkie emocje i mimika

Style anime i kreskówkowe

Lifestyle i jedzenie

Czego wciąż nie wiemy

Benchmarki to tylko jeden punkt widzenia. Oto czego nam brakuje, by uznać HappyHorse-1.0 za bezsprzecznie najlepsze narzędzie:

Brak publicznego API. "Wkrótce dostępne" to wszystko, co wiemy. Data premiery nie jest potwierdzona.

Brak dokumentacji technicznej. Nie opublikowano szczegółów architektury, informacji o danych treningowych ani metodologii.

Specyfikacja rozdzielczości i czasu trwania: niepotwierdzona. Maksymalna rozdzielczość, liczba klatek na sekundę i długość wideo nie są znane.

Brak cennika. Bez działającego API nie można porównać kosztów z konkurencją (np. SkyReels V4 kosztuje ok. 7,20 USD/min, wideo Grok ok. 4,20 USD/min).

Status Open-source: nieznany. Model nie figuruje w filtrze "Open weights" w Artificial Analysis.

Dlaczego to ważne: Model, który wygrywa w rankingach, ale kosztuje 10 razy więcej lub działa tylko przez połowę czasu, nie zdominuje rynku. Wydajność jest konieczna, ale niewystarczająca. Będziemy aktualizować ten artykuł, gdy pojawią się nowe szczegóły.

Co HappyHorse-1.0 mówi nam o rynku AI wideo

Poza samym modelem, pojawienie się HappyHorse-1.0 pokazuje trzy trendy w branży.

Liderzy to nie tylko znane twarze

Google, OpenAI i ByteDance mają największe budżety. Ale model numer 1 na świecie wyszedł od zespołu, który wydzielił się z laboratorium badawczego platformy zakupowej. Jeśli budujesz coś w tej branży — jako startup, twórca open-source czy zespół innowacji w korporacji — to powinno być motywujące. Drzwi są otwarte.

Ekosystem AI wideo w Chinach wysuwa się na prowadzenie

Spójrz jeszcze raz na ranking tekst-na-wideo. Cztery z pięciu najlepszych modeli pochodzą od chińskich zespołów: HappyHorse, ByteDance Seed, Skywork AI, KlingAI. To nie anomalia — to stały trend. Chińskie możliwości generowania AI wideo są nie tylko konkurencyjne; według obecnych benchmarków są wiodące.

Integracja dźwięku i wideo to kolejne pole bitwy

Artificial Analysis prowadzi teraz osobne rankingi dla opcji "z dźwiękiem" i "bez dźwięku". Ten podział wynika z faktu, że rynek zmierza w stronę w pełni zintegrowanego generowania audiowizualnego. Minimalna przewaga HappyHorse-1.0 w kategoriach audio sugeruje, że był on projektowany z myślą o tej multimodalnej przyszłości — ale konkurencja robi to samo. Układ sił będzie się zmieniał. Ten wyścig dopiero się zaczyna.

Często zadawane pytania (FAQ)

Kluczowe wnioski

HappyHorse-1.0 to obecnie numer 1 wśród modeli AI wideo we wszystkich czterech rankingach Artificial Analysis — tekst-na-wideo, obraz-na-wideo, z dźwiękiem i bez — oceniony na podstawie ponad 31 000 próbek.

Dominacja jest najwyraźniejsza w czystym generowaniu wideo (bez dźwięku), gdzie prowadzi o 57–106 punktów ELO. W kategoriach z dźwiękiem rywalizacja jest wyrównana — różnice to tylko 2–3 punkty.

Pochodzenie zespołu jest zaskakujące. Stworzony przez grupę wydzieloną z infrastruktury badawczej e-commerce Alibaby, a nie z tradycyjnego laboratorium AI. To sygnał, że zespoły inżynierii stosowanej mogą skutecznie rywalizować w absolutnej czołówce.

Wiele niewiadomych. Brak publicznego API, cen, dokumentacji technicznej i potwierdzonej specyfikacji. Liderowanie w rankingach nie oznacza jeszcze dostępności dla każdego.

Warto śledzić temat. Po uruchomieniu API dane o kosztach i niezawodności pokażą, czy HappyHorse-1.0 stanie się standardowym narzędziem, czy pozostanie jedynie ciekawostką z rankingów. Będziemy aktualizować artykuł na bieżąco.

Ostatnia aktualizacja: kwiecień 2026. Dane pochodzą z Artificial Analysis. Rankingi są dynamiczne i mogą się zmieniać wraz z dodawaniem nowych ocen.