Hvad er HappyHorse-1.0? Den ukendte AI-videomodel, der lige har toppet alle de store benchmarks

Sidst opdateret: Apr. 2026

En model, som ingen havde forudset, har netop indtaget førstepladsen på alle fire video-ranglister hos Artificial Analysis – den mest citerede uafhængige platform til evaluering af AI-video.

Navnet er: HappyHorse-1.0.

Den kommer ikke fra Google. Ikke fra OpenAI. Ikke fra ByteDance. Men fra et uafhængigt laboratorium udsprunget af en e-handelsvirksomhed.

Her er, hvad denne artikel giver dig på ca. 8 minutter: Et klart billede af, hvad HappyHorse-1.0 egentlig er, hvem der har bygget den, præcis hvordan den præsterer mod de største konkurrenter (med komplette tabeller), hvad vi stadig ikke ved, og hvad det betyder for dig, der arbejder med AI-video på det ene eller andet niveau.

Lad os kaste os ud i det.

Hurtigt overblik over HappyHorse-1.0

HappyHorse-1.0 er en AI-videomodel, der understøtter:

Tekst-til-video syntese

Billede-til-video syntese

Integreret lydgenerering

Den blev udgivet i april 2026 og strøg direkte ind som nummer et på samtlige ranglister hos Artificial Analysis – en bedrift, ingen model har udført før.

Det, der gør, at den skiller sig ud, er ikke bare én smart funktion. Det er stabiliteten: HappyHorse-1.0 overgår modeller fra ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) og andre – på tværs af flere forskellige opgaver på samme tid.

Lige en hurtig præcisering: At toppe benchmarks gør ikke automatisk en model til det bedste værktøj til alle arbejdsgange. Benchmarks måler folks præferencer i kontrollerede sammenligninger. De måler ikke API-oppetid, priser eller pålidelighed i specielle grænsetilfælde. Men når en model fører alle fire ranglister baseret på over 31.000 testeksempler, så er det ikke længere bare tilfældigheder. Så er det et signal, man bør tage seriøst.

I skrivende stund står API'en som "Coming soon" – der er altså ingen offentlig adgang endnu.

Hvem har bygget HappyHorse-1.0?

Her er den del, der kom helt bag på AI-miljøet.

Man ville forvente, at verdens førende videomodel kom fra et velpolstret AI-forskningslaboratorium. Men HappyHorse-1.0 er bygget af et team ledet af Zhang Di, som oprindeligt arbejdede under Taotian Groups Future Life Lab.

Hvad er Taotian Group? Det er selskabet bag Taobao og Tmall – Alibabas kerneplatforme inden for e-handel. Future Life Lab blev skabt under ATH-AI Innovation Division, en intern udviklingsafdeling. Siden da er det blevet skilt ud som en uafhængig enhed.

Er det så bare "Alibabas videomodel" under et andet navn?

Ikke helt. Teamet er blevet adskilt fra moderorganisationen. Men deres baggrund betyder noget: Årevis med adgang til infrastruktur i Alibaba-skala, datastrømme og dygtige ingeniører har tydeligvis givet grundlaget for at bygge noget på dette niveau.

Det er en tendens, man bør holde øje med. Inden for AI er de mest banebrydende spillere ofte ikke dem med flest forskere bag sig. Det er dem med de stærkeste ingeniørkræfter – teams, der er vante til at levere rigtige produkter i stor skala og tager den disciplin med ind i modeludviklingen.

Tænk på det på denne måde: Google DeepMind har over 1.000 forskere. Men et fokuseret team på ca. 50 ingeniører, der har bygget anbefalingssystemer i realtid til en milliard brugere? De forstår optimering, infrastruktur og driftsikkerhed på et niveau, som rene forskningslaboratorier nogle gange misser.

Benchmarks: Den fulde gennemgang

Lad os nu se på, hvad der rent faktisk skete på ranglisterne. Det er disse data, der har gjort det umuligt at ignorere HappyHorse-1.0.

Ranglisten herunder er hentet fra Artificial Analysis (april 2026). Pointene er ELO-baserede, hvilket betyder, at de er baseret på menneskelige præferencer i direkte sammenligninger – rigtige mennesker ser videoer side om side og vælger den bedste.

1. Tekst-til-video (uden lyd)

| Rang | Model | Skaber | ELO-score | Samples |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.379 | 8.819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.273 | 8.426 |

| 3 | SkyReels V4 | Skywork AI | 1.245 | 5.956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1.242 | 5.390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.230 | 4.879 |

Forspring til nr. 2: +106 ELO-point.

Hvor meget er det? I skak svarer 100 point ca. til forskellen på en stærk klubspiller og en spiller på nationalt niveau. Det er ikke bare en tilfældighed – det er et helt andet niveau.

2. Billede-til-video (uden lyd)

| Rang | Model | Skaber | ELO-score | Samples |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.413 | 9.056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.356 | 4.656 |

| 3 | grok-imagine-video | xAI | 1.332 | 6.299 |

| 4 | PixVerse V6 | PixVerse | 1.318 | 9.441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.298 | 4.741 |

Forspring til nr. 2: +57 ELO-point.

Dette er HappyHorse-1.0's højeste absolutte score (1.413) i alle kategorier. Billede-til-video er ofte der, hvor modeller viser svagheder – at bevare sammenhæng i bevægelserne og samtidig respektere kildebilledet er teknisk svært. En stærk score her tyder på en solid rumlig forståelse.

3. Tekst-til-video (med lyd)

| Rang | Model | Skaber | ELO-score | Samples |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.225 | 6.684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.222 | 7.873 |

| 3 | SkyReels V4 | Skywork AI | 1.142 | 5.226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1.108 | 5.346 |

Forspring til nr. 2: +3 ELO-point.

Hårfin forskel. Det fortæller os noget vigtigt: Indbygget lydgenerering er den nye frontlinje, og ingen model er stukket af endnu. Alle de store spillere ligger meget tæt her.

4. Billede-til-video (med lyd)

| Rang | Model | Skaber | ELO-score | Samples |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1.162 | 6.896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1.160 | 4.831 |

| 3 | SkyReels V4 | Skywork AI | 1.084 | 5.524 |

| 4 | Veo 3.1 Fast | 1.075 | 4.680 |

Forspring til nr. 2: +2 ELO-point.

Endnu et tæt løb. Men mønsteret holder: HappyHorse-1.0 er nr. 1 i samtlige kategorier.

Opsummering af situationen

Hvad fortæller de samlede data os?

I ren videokvalitet (uden lyd): HappyHorse-1.0 har et solidt forspring – 57 til 106 ELO-point foran. Her er den stærkest.

I video med integreret lyd: Forspringet skrumper til 2–3 point. Her er feltet helt tæt, og teknologien er stadig i rivende udvikling.

På tværs af alle fire ranglister: Over 31.000 testeksempler. Det her er ikke bare en heldig test med et lille datasæt.

Den vigtigste konklusion fra disse benchmarks: HappyHorse-1.0 er uden tvivl den stærkeste model til ren videogenerering og ligger i toppen, når det gælder den nyere disciplin med kombineret lyd og video.

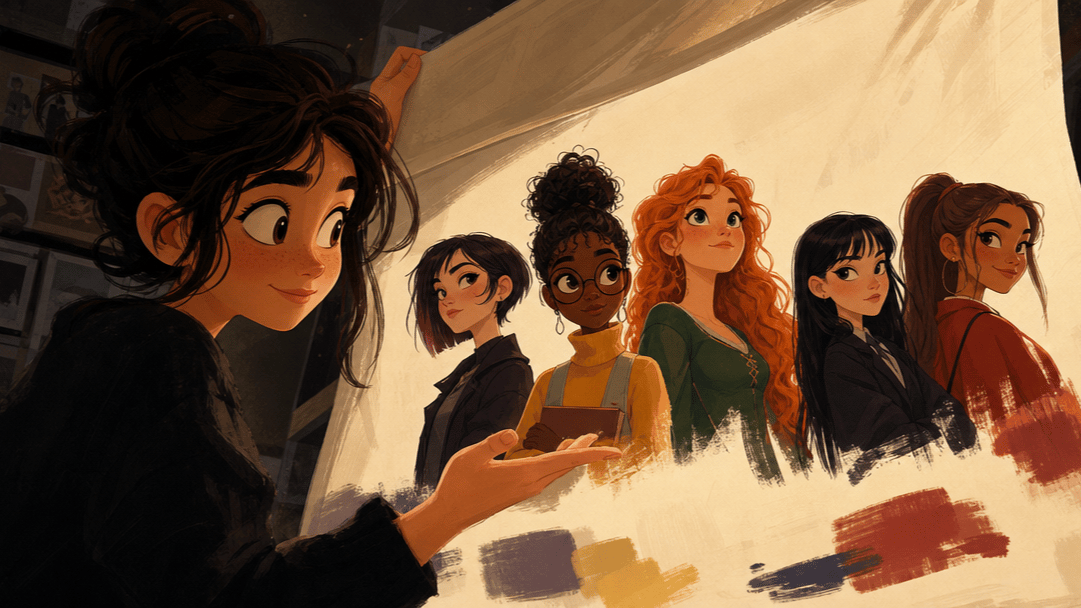

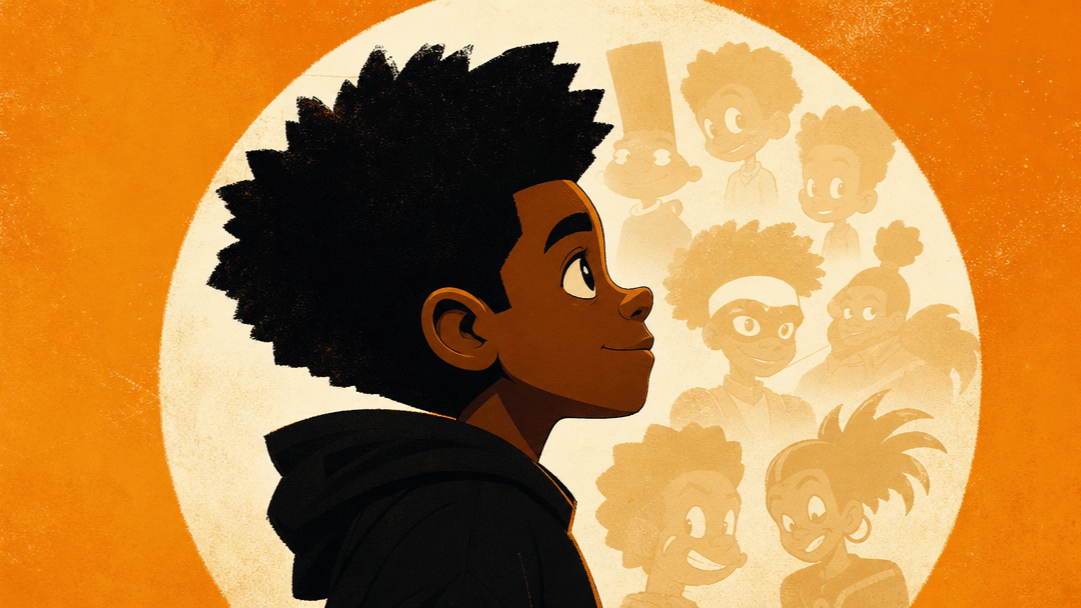

HappyHorse-1.0 i aktion: Galleri med eksempler

3D-karakteranimation

Fotorealistiske filmscener

Natur og makrodetaljer

Menneskelige følelser og udtryk

Anime- og tegneseriestil

Livsstil og mad

3D-karakteranimation

Fotorealistiske filmscener

Natur og makrodetaljer

Menneskelige følelser og udtryk

Anime- og tegneseriestil

Livsstil og mad

Hvad vi stadig ikke ved

Benchmarks er én ting. Her er, hvad vi stadig mangler at få svar på, før vi kan kåre HappyHorse-1.0 som det ultimative værktøj:

Ingen offentlig API endnu. "Coming soon" er alt, hvad vi ved. Der er ingen bekræftet dato.

Ingen teknisk dokumentation. Der er ikke udgivet detaljer om arkitektur, træningsdata eller metoder.

Specifikationer for opløsning og varighed er ubekræftede. Maksimal opløsning, framerate og videolængde er ikke oplyst.

Ingen priser. Uden en aktiv API er det umuligt at sammenligne prisen med konkurrenterne (f.eks. SkyReels V4 til ca. $7,20/min eller Grok video til ca. $4,20/min).

Open source-status: ukendt. Den er ikke listet under Artificial Analysis’ filter for "Open weights".

Hvorfor det betyder noget: En model, der scorer højt, men koster 10 gange mere eller kun virker halvdelen af tiden, bliver aldrig standarden i den virkelige verden. Præstation er vigtig, men det gør det ikke alene. Vi opdaterer artiklen, så snart vi ved mere.

Hvad HappyHorse-1.0 fortæller os om AI-videomarkedet

Udover selve modellen fortæller HappyHorse-1.0 os tre ting om, hvor branchen bevæger sig hen.

De store sidder ikke på det hele

Google, OpenAI og ByteDance har de største budgetter. Men ranglistens nr. 1 kommer fra et team udsprunget af et udviklingslaboratorium hos en shopping-platform. Hvis du bygger noget i dette felt – som startup, open source-bidragsyder eller i en innovationsafdeling – er det her opmuntrende. Døren står åben.

Kinas AI-video-økosystem fører an

Kig på tekst-til-video-ranglisten igen. Fire ud af de fem bedste modeller er fra kinesiske teams: HappyHorse, ByteDance Seed, Skywork AI, KlingAI. Det er ikke en enlig svale – det er et mønster. Kinas evner inden for AI-videogenerering er ikke bare konkurrencedygtige; baseret på de nuværende benchmarks fører de an.

Lyd + video-integration er det næste store slag

Artificial Analysis måler nu særskilt på "med lyd" og "uden lyd". Den opdeling findes, fordi markedet bevæger sig mod fuldt integreret audiovisuel generering. HappyHorse-1.0's spinkle føring i lydkategorierne tyder på, at den er designet med denne multimodale fremtid for øje – men det er de andre også. Forspringet vil flytte sig. Det her kapløb er kun lige begyndt.

Ofte stillede spørgsmål (FAQ)

Hovedpunkter

HappyHorse-1.0 er den førende AI-videomodel lige nu på tværs af alle fire ranglister hos Artificial Analysis – tekst-til-video, billede-til-video, med og uden lyd – vurderet på over 31.000 testeksempler.

Den er mest overlegen i ren videogenerering (uden lyd), hvor den fører med 57–106 ELO-point. I kategorierne med lyd ligger hele feltet meget tættere med kun 2–3 points forskel.

Teamets baggrund er uventet. Den er bygget af en gruppe udsprunget af Alibabas e-handels-infrastruktur fremfor et traditionelt AI-forskningscenter. Det viser, at ingeniørtunge teams kan konkurrere med de absolut bedste.

Der er stadig store spørgsmålstegn. Ingen offentlig API, ingen priser, ingen teknisk dokumentation og ingen bekræftede specifikationer. At føre i benchmarks er ikke det samme som at være tilgængelig i praksis.

Hold øje med dette felt. Når API'en lander, vil data om pris og stabilitet afgøre, om HappyHorse-1.0 bliver et uundværligt værktøj eller blot forbliver en nysgerrighed i statistikken. Vi opdaterer artiklen i takt med, at der kommer nye detaljer.

Sidst opdateret: April 2026. Benchmark-data er hentet fra Artificial Analysis. Ranglisterne er dynamiske og kan ændre sig, efterhånden som nye evalueringer tilføjes.