C'est quoi HappyHorse-1.0 ? Le modèle IA vidéo méconnu qui vient de dominer tous les benchmarks

Dernière mise à jour : avril 2026

Un modèle que personne n'attendait vient de prendre la première place sur les quatre classements de génération vidéo suivis par Artificial Analysis — la plateforme d'évaluation indépendante la plus citée pour l'IA vidéo.

Son nom : HappyHorse-1.0.

Il ne vient pas de Google. Ni d'OpenAI. Ni de ByteDance. Mais d'un labo indépendant issu d'une entreprise d'e-commerce.

Voici ce que cet article vous apprendra en environ 8 minutes : une vision claire de ce qu'est réellement HappyHorse-1.0, qui l'a conçu, ses performances exactes face à ses principaux concurrents (avec tableaux comparatifs complets), les zones d'ombre restantes et ce que cela change pour vous si vous travaillez de près ou de loin avec la vidéo IA.

C'est parti.

Aperçu de HappyHorse-1.0

HappyHorse-1.0 est un modèle de génération vidéo par IA qui prend en charge :

La synthèse Text-to-video (texte vers vidéo)

La synthèse Image-to-video (image vers vidéo)

La génération audio intégrée

Sorti en avril 2026, il s'est immédiatement imposé en tête de chaque classement vidéo d'Artificial Analysis — une première pour un seul et même modèle.

Ce qui le distingue, ce n'est pas une fonctionnalité gadget, mais sa constance : HappyHorse-1.0 surpasse les modèles de ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) et d'autres — sur plusieurs types de tâches simultanément.

Précision rapide : Être en tête des benchmarks ne fait pas automatiquement d'un modèle le meilleur outil pour tous les flux de travail. Les benchmarks mesurent les préférences humaines lors de comparaisons directes contrôlées. Ils ne mesurent pas la disponibilité de l'API, les tarifs ou la fiabilité sur des cas particuliers. Mais quand un modèle domine quatre classements sur plus de 31 000 échantillons d'évaluation, ce n'est plus du bruit statistique. C'est un signal qu'il faut prendre au sérieux.

Pour l'instant, l'API est indiquée comme "Prochainement disponible" — aucun accès public pour le moment.

Qui a créé HappyHorse-1.0 ?

C'est ici que la communauté IA a été prise de court.

On s'attendrait à ce que le meilleur modèle vidéo au monde vienne d'un labo de recherche pur, ultra-financé. Au lieu de cela, HappyHorse-1.0 a été conçu par une équipe dirigée par Zhang Di, opérant initialement au sein du Future Life Lab de Taotian Group.

Qu'est-ce que Taotian Group ? C'est l'entité derrière Taobao et Tmall — les plateformes e-commerce phares d'Alibaba. Le Future Life Lab a été créé sous la Division Innovation ATH-AI, une unité de R&D interne. Il est depuis devenu une entité indépendante.

Est-ce donc juste le "modèle vidéo d'Alibaba" sous un autre nom ?

Pas tout à fait. L'équipe s'est séparée de l'organisation mère. Mais leur héritage compte : des années d'accès à l'infrastructure, aux flux de données et aux talents d'ingénierie à l'échelle d'Alibaba ont clairement servi de fondation pour construire un outil de ce niveau.

C'est une tendance à surveiller. Dans l'IA, les acteurs les plus disruptifs ne sont pas toujours ceux qui ont le plus de chercheurs, mais ceux qui ont la meilleure force de frappe en ingénierie appliquée — des équipes habituées à déployer des produits à grande échelle.

Les Benchmarks : Analyse complète des performances

Regardons maintenant ce qui s'est réellement passé sur les classements. Ce sont ces données qui ont rendu HappyHorse-1.0 impossible à ignorer.

Les classements ci-dessous proviennent d'Artificial Analysis (avril 2026). Les scores sont basés sur le système ELO, ce qui signifie qu'ils proviennent de comparaisons de préférences humaines en face-à-face.

1. Text-to-Video (Sans Audio)

| Rang | Modèle | Créateur | Score ELO | Échantillons |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 379 | 8 819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 273 | 8 426 |

| 3 | SkyReels V4 | Skywork AI | 1 245 | 5 956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1 242 | 5 390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 230 | 4 879 |

Écart avec le n°2 : +106 points ELO.

C'est énorme. Aux échecs, 100 points d'écart représentent la différence entre un bon joueur de club et un compétiteur de niveau national. Ce n'est pas un coup de chance, c'est un changement de catégorie.

2. Image-to-Video (Sans Audio)

| Rang | Modèle | Créateur | Score ELO | Échantillons |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 413 | 9 056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 356 | 4 656 |

| 3 | grok-imagine-video | xAI | 1 332 | 6 299 |

| 4 | PixVerse V6 | PixVerse | 1 318 | 9 441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 298 | 4 741 |

Écart avec le n°2 : +57 points ELO.

C'est le score absolu le plus élevé de HappyHorse-1.0 (1 413). L'Image-to-video est souvent là où les faiblesses apparaissent — car garder la cohérence du mouvement tout en respectant l'image source est complexe. Un score I2V aussi fort suggère une compréhension spatiale robuste.

3. Text-to-Video (Avec Audio)

| Rang | Modèle | Créateur | Score ELO | Échantillons |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 225 | 6 684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 222 | 7 873 |

| 3 | SkyReels V4 | Skywork AI | 1 142 | 5 226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1 108 | 5 346 |

Écart avec le n°2 : +3 points ELO.

Ici, c'est serré. Cela nous apprend une chose : la génération audio native est le nouveau champ de bataille, et aucun modèle ne s'est encore détaché du lot.

4. Image-to-Video (Avec Audio)

| Rang | Modèle | Créateur | Score ELO | Échantillons |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1 162 | 6 896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1 160 | 4 831 |

| 3 | SkyReels V4 | Skywork AI | 1 084 | 5 524 |

| 4 | Veo 3.1 Fast | 1 075 | 4 680 |

Écart avec le n°2 : +2 points ELO.

Encore une quasi-égalité. Mais la tendance se confirme : HappyHorse-1.0 est n°1 dans toutes les catégories.

Analyse globale

Quelles conclusions tirer de ces données ?

En qualité vidéo pure (sans audio) : HappyHorse-1.0 a une avance confortable. C'est son point fort absolu.

En vidéo avec audio intégré : L'avance se réduit à 2–3 points. C'est une course au coude-à-coude sur un terrain encore en pleine maturation.

Sur l'ensemble des classements : Plus de 31 000 échantillons d'évaluation. Ce n'est pas un coup de chance sur un petit échantillon.

L'idée à retenir des benchmarks : HappyHorse-1.0 est indiscutablement le modèle le plus puissant pour la génération vidéo pure, et leader (bien que de peu) sur les tâches audio-vidéo combinées.

HappyHorse-1.0 en action : Galerie d'exemples

Animation de personnages 3D

Cinématographie photoréaliste

Nature et détails macro

Émotions et expressions humaines

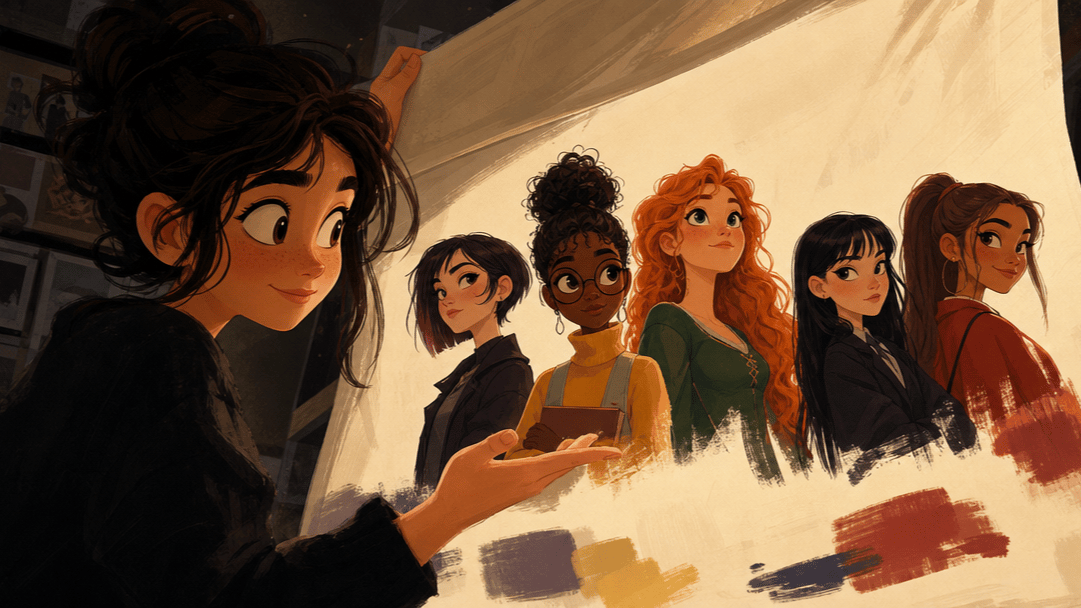

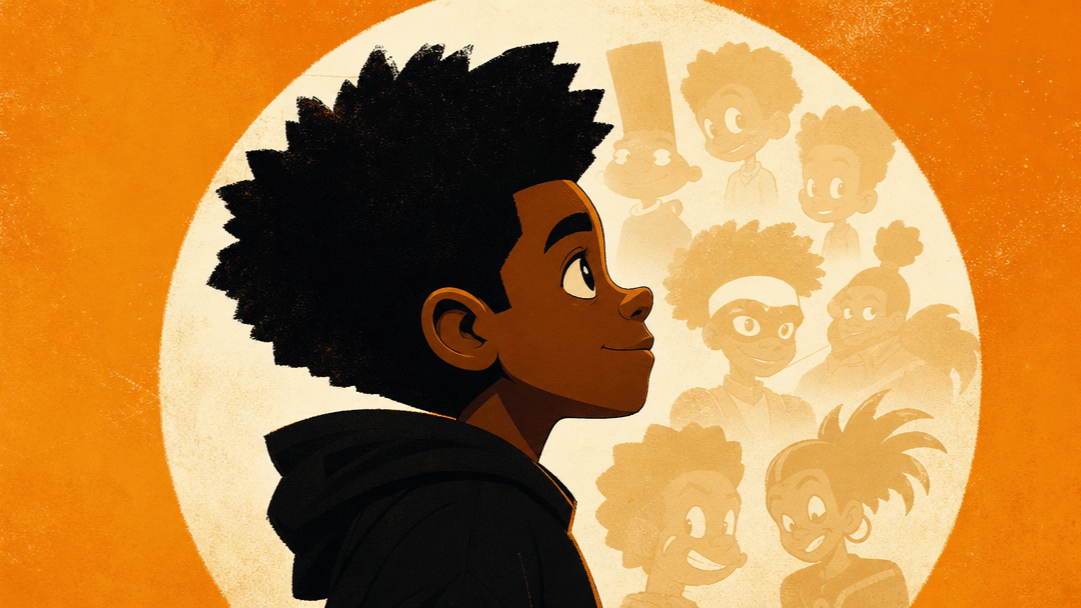

Styles Anime et Cartoon

Style de vie et Gastronomie

Animation de personnages 3D

Cinématographie photoréaliste

Nature et détails macro

Émotions et expressions humaines

Styles Anime et Cartoon

Style de vie et Gastronomie

Ce que nous ne savons pas encore

Les benchmarks sont une chose. Voici ce qu'il manque avant de pouvoir dire que HappyHorse-1.0 est le meilleur outil définitif :

Pas encore d'API publique. "Prochainement" est tout ce que nous avons. Pas de date de sortie confirmée.

Pas de papier technique. Aucun détail sur l'architecture, les données d'entraînement ou la méthodologie n'a été publié.

Spécifications floues. La résolution maximale, le taux de rafraîchissement et la durée des vidéos ne sont pas précisés.

Pas de tarifs. Sans API active, impossible de comparer les coûts avec ses concurrents (ex: SkyReels V4 à env. 7,20 $/min).

Statut open source : inconnu. Il ne figure pas dans le filtre "Poids ouverts" d'Artificial Analysis.

Pourquoi c'est important : Un modèle ultra-performant mais qui coûte 10 fois plus cher ou dont l'API est souvent en panne ne dominera pas le marché réel. La performance est nécessaire, mais elle ne suffit pas.

Ce que HappyHorse-1.0 révèle sur le marché de l'IA vidéo

Au-delà du modèle lui-même, l'émergence de HappyHorse-1.0 nous montre trois tendances majeures du secteur.

La frontière technologique n'est pas réservée aux géants habituels

Google, OpenAI et ByteDance ont les plus gros budgets. Pourtant, le modèle vidéo n°1 vient d'une équipe issue d'un labo de R&D d'une plateforme de shopping. Pour les startups et les contributeurs open source, c'est un signal encourageant : la porte reste ouverte.

L'écosystème de l'IA vidéo chinoise prend le large

Regardez à nouveau le classement Text-to-video. Quatre des cinq meilleurs modèles viennent d'équipes chinoises : HappyHorse, ByteDance Seed, Skywork AI, KlingAI. Ce n'est pas une exception, c'est une tendance lourde. La capacité de génération vidéo IA de la Chine est aujourd'hui en tête des benchmarks actuels.

L'intégration Audio + Vidéo est le prochain champ de bataille

Artificial Analysis suit désormais des classements séparés "avec audio" et "sans audio". Cela prouve que le marché se dirige vers une génération audiovisuelle totalement intégrée. Si HappyHorse-1.0 a été conçu pour ce futur multimodal, ses concurrents aussi. La course ne fait que commencer.

FAQ

Points clés à retenir

HappyHorse-1.0 est l'actuel n°1 des modèles vidéo IA sur les quatre classements d'Artificial Analysis, avec plus de 31 000 échantillons évalués.

Sa domination est flagrante en génération vidéo pure (sans audio), où il mène de 57 à 106 points ELO. Pour l'audio, la compétition est beaucoup plus serrée (2-3 points d'écart).

L'origine de l'équipe est surprenante. Créé par un groupe issu de l'infrastructure R&D e-commerce d'Alibaba, et non d'un labo de recherche IA traditionnel.

Des inconnues majeures subsistent. Pas d'API publique, pas de prix, pas de papier technique. Dominer les benchmarks ne signifie pas encore être accessible.

Affaire à suivre. Au lancement de l'API, les données de coût et de fiabilité diront si HappyHorse-1.0 devient un outil standard ou reste une curiosité de benchmark. Nous mettrons cet article à jour dès que nécessaire.

Dernière mise à jour : avril 2026. Données provenant d'Artificial Analysis. Les classements sont dynamiques.