O que é o HappyHorse-1.0? O modelo de vídeo IA desconhecido que acaba de superar todos os principais benchmarks

Última atualização: abr de 2026

Um modelo que ninguém previu acaba de conquistar o 1.º lugar em todos os quatro quadros de líderes (leaderboards) de geração de vídeo monitorizados pela Artificial Analysis — a plataforma de avaliação independente mais citada para IA de vídeo.

O seu nome: HappyHorse-1.0.

Não vem da Google. Nem da OpenAI. Nem da ByteDance. Vem de um laboratório independente que nasceu dentro de uma empresa de e-commerce.

Eis o que este artigo lhe vai dar em cerca de 8 minutos: uma visão clara do que é realmente o HappyHorse-1.0, quem o criou, exatamente como se comporta face a todos os grandes concorrentes (com tabelas de benchmark completas), o que ainda não sabemos e o que isto significa se trabalha com vídeo IA a qualquer nível.

Vamos a isto.

HappyHorse-1.0 num relance

O HappyHorse-1.0 é um modelo de geração de vídeo por IA que suporta:

Síntese de texto-para-vídeo

Síntese de imagem-para-vídeo

Geração de áudio integrada

Foi lançado em abril de 2026 e assumiu imediatamente a liderança em todos os rankings de vídeo da Artificial Analysis — um feito inédito para um único modelo.

O que o destaca não é apenas uma funcionalidade vistosa. É a sua consistência: o HappyHorse-1.0 supera modelos da ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) e outros — em vários tipos de tarefas simultaneamente.

Um esclarecimento rápido: Liderar os benchmarks não torna automaticamente um modelo na melhor ferramenta para todos os fluxos de trabalho. Os benchmarks medem a preferência humana em comparações diretas controladas. Não medem o tempo de atividade da API, preços ou fiabilidade em casos extremos. Mas quando um modelo lidera os quatro rankings em mais de 31.000 amostras de avaliação, já não é apenas ruído. É um sinal que vale a pena compreender.

Até ao momento, a API está listada como "Brevemente" — ainda sem acesso público.

Quem criou o HappyHorse-1.0?

Aqui está a parte que apanhou a comunidade de IA de surpresa.

Seria de esperar que o modelo de vídeo n.º 1 do mundo viesse de um laboratório de investigação de IA puro e bem financiado. Em vez disso, o HappyHorse-1.0 foi construído por uma equipa liderada por Zhang Di, que operava originalmente dentro do Future Life Lab do Taotian Group.

O que é o Taotian Group? É a entidade por trás do Taobao e Tmall — as principais plataformas de e-commerce da Alibaba. O Future Life Lab foi criado sob a ATH-AI Innovation Division, uma unidade interna de I&D. Entretanto, tornou-se uma entidade independente.

Então, isto é apenas o "modelo de vídeo da Alibaba" com outro nome?

Não exatamente. A equipa separou-se da organização-mãe. Mas o seu legado importa: anos de acesso a infraestruturas à escala da Alibaba, pipelines de dados e talento de engenharia forneceram claramente as bases para construir algo a este nível.

É um padrão a acompanhar. Na IA, os novos intervenientes mais disruptivos muitas vezes não são os que têm o maior número de investigadores. São os que têm a melhor engenharia aplicada — equipas que têm lançado produtos em escala e trazem essa disciplina para o desenvolvimento de modelos.

Pense desta forma: a Google DeepMind tem mais de 1.000 investigadores. Mas uma equipa focada de cerca de 50 engenheiros que tem construído sistemas de recomendação em tempo real para mil milhões de utilizadores? Eles entendem de otimização, infraestrutura e fiabilidade a um nível que os laboratórios de investigação pura, por vezes, não alcançam.

Os Benchmarks: Decomposição total do desempenho

Agora, vejamos o que realmente aconteceu nos rankings. Estes são os dados que tornaram o HappyHorse-1.0 impossível de ignorar.

As classificações abaixo provêm da Artificial Analysis (abril de 2026). As pontuações baseiam-se no sistema ELO, o que significa que derivam de comparações de preferência humana direta — pessoas reais a ver vídeos gerados lado a lado e a escolher o melhor.

1. Texto-para-Vídeo (Sem Áudio)

| Rank | Modelo | Criador | Pontuação ELO | Amostras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1,379 | 8,819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1,273 | 8,426 |

| 3 | SkyReels V4 | Skywork AI | 1,245 | 5,956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1,242 | 5,390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1,230 | 4,879 |

Vantagem sobre o n.º 2: +106 pontos ELO.

O quão grande é isto? Em termos de ELO de xadrez, uma diferença de 100 pontos é sensivelmente a diferença entre um jogador de clube forte e um competidor de nível nacional. Não é um golpe de sorte — é uma categoria acima.

2. Imagem-para-Vídeo (Sem Áudio)

| Rank | Modelo | Criador | Pontuação ELO | Amostras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1,413 | 9,056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1,356 | 4,656 |

| 3 | grok-imagine-video | xAI | 1,332 | 6,299 |

| 4 | PixVerse V6 | PixVerse | 1,318 | 9,441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1,298 | 4,741 |

Vantagem sobre o n.º 2: +57 pontos ELO.

Esta é a pontuação absoluta mais alta do HappyHorse-1.0 (1,413) em todas as categorias. A imagem-para-vídeo é muitas vezes onde os modelos revelam fraquezas — manter a coerência do movimento respeitando a imagem de origem é tecnicamente exigente. Uma pontuação I2V forte sugere uma compreensão espacial robusta.

3. Texto-para-Vídeo (Com Áudio)

| Rank | Modelo | Criador | Pontuação ELO | Amostras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1,225 | 6,684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1,222 | 7,873 |

| 3 | SkyReels V4 | Skywork AI | 1,142 | 5,226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1,108 | 5,346 |

Vantagem sobre o n.º 2: +3 pontos ELO.

Uma margem mínima. Isto diz-nos algo importante: a geração de áudio nativo é a nova fronteira competitiva, e nenhum modelo se destacou verdadeiramente ainda. Todos os principais jogadores estão a convergir aqui.

4. Imagem-para-Vídeo (Com Áudio)

| Rank | Modelo | Criador | Pontuação ELO | Amostras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1,162 | 6,896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1,160 | 4,831 |

| 3 | SkyReels V4 | Skywork AI | 1,084 | 5,524 |

| 4 | Veo 3.1 Fast | 1,075 | 4,680 |

Vantagem sobre o n.º 2: +2 pontos ELO.

Outro empate técnico. Mas o padrão mantém-se: o HappyHorse-1.0 é o n.º 1 em todas as categorias.

Análise do Quadro Geral

O que nos dizem os dados completos?

Em qualidade de vídeo pura (sem áudio): O HappyHorse-1.0 tem uma liderança dominante — 57 a 106 pontos ELO à frente. Esta é a sua zona mais forte.

Em vídeo com áudio integrado: A vantagem reduz-se para 2–3 pontos. É uma disputa taco a taco onde todo o setor ainda está a amadurecer.

Em todos os quatro rankings combinados: Mais de 31.000 amostras de avaliação. Isto não é um acaso num conjunto de testes pequeno.

A principal conclusão dos benchmarks: o HappyHorse-1.0 é definitivamente o modelo mais forte para a geração de vídeo pura e é competitivo ou líder na mais recente tarefa de combinação áudio-vídeo.

HappyHorse-1.0 em Ação: Galeria de Amostras

Animação de Personagens 3D

Cinematografia Fotorrealista

Natureza e Detalhes Macro

Emoção e Expressão Humana

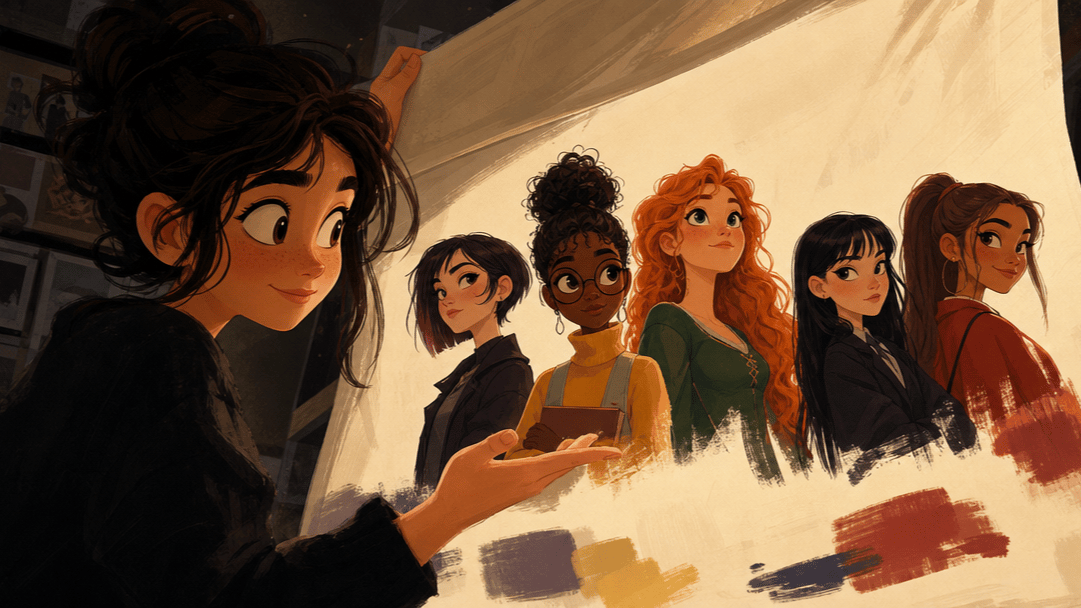

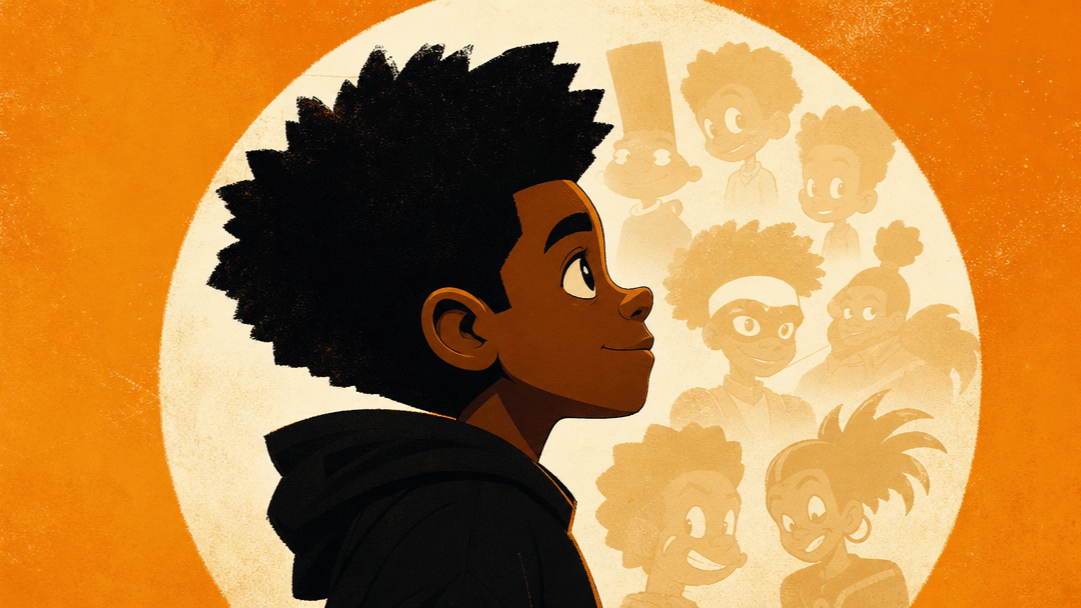

Estilos Anime e Cartoon

Estilo de Vida e Gastronomia

Animação de Personagens 3D

Cinematografia Fotorrealista

Natureza e Detalhes Macro

Emoção e Expressão Humana

Estilos Anime e Cartoon

Estilo de Vida e Gastronomia

O que ainda não sabemos

Os benchmarks são apenas uma perspetiva. Aqui está o que falta antes de alguém poder rotular o HappyHorse-1.0 como a ferramenta definitiva:

Ainda sem API pública. "Brevemente" é tudo o que temos. Nenhuma data de lançamento confirmada.

Sem artigo técnico (paper). Não foram publicados detalhes de arquitetura, dados de treino ou metodologia.

Especificações de resolução e duração: não confirmadas. Resolução máxima, taxa de fotogramas e duração do vídeo não estão listadas.

Sem preços. Sem uma API ativa, as comparações de custos com concorrentes (ex: SkyReels V4 a ~$7,20/min, Grok vídeo a ~$4,20/min) são impossíveis.

Estado de open-source: desconhecido. Não está listado no filtro de "Open weights" da Artificial Analysis.

Por que é que isto importa: Um modelo com a pontuação mais alta, mas que custa 10 vezes mais ou tem 50% de tempo de atividade na API, não dominará o uso no mundo real. O desempenho é necessário, mas não suficiente. Atualizaremos este artigo à medida que estes detalhes surgirem.

O que o HappyHorse-1.0 sinaliza sobre o mercado de IA de Vídeo

Para além do modelo em si, o aparecimento do HappyHorse-1.0 diz-nos três coisas sobre o rumo da indústria.

A fronteira tecnológica não está fechada aos suspeitos do costume

Google, OpenAI e ByteDance têm os maiores orçamentos. Mas o modelo de vídeo n.º 1 veio de uma equipa que saiu de um laboratório de I&D de uma plataforma de compras. Se está a construir neste espaço — como startup, contribuidor open-source ou equipa de inovação corporativa — isto deve ser encorajador. A porta está aberta.

O ecossistema de vídeo IA da China está a ganhar vantagem

Olhe novamente para o ranking de texto-para-vídeo. Quatro dos cinco melhores modelos são de equipas chinesas: HappyHorse, ByteDance Seed, Skywork AI, KlingAI. Isto não é um caso isolado — é um padrão. A capacidade de geração de vídeo por IA da China não é apenas competitiva; nos benchmarks atuais, está a liderar.

A integração de áudio + vídeo é o próximo campo de batalha

A Artificial Analysis monitoriza agora rankings separados para "com áudio" e "sem áudio". Essa divisão existe porque o mercado está a caminhar para a geração audiovisual totalmente integrada. As ligeiras vantagens do HappyHorse-1.0 nas categorias de áudio sugerem que foi desenhado a pensar neste futuro multimodal — mas todos os outros também o foram. As margens vão mudar. Esta corrida está apenas a começar.

Perguntas Frequentes (FAQ)

Principais Conclusões

O HappyHorse-1.0 é o atual modelo de vídeo IA n.º 1 em todos os quatro rankings da Artificial Analysis — texto-para-vídeo, imagem-para-vídeo, com e sem áudio — avaliado em mais de 31.000 amostras.

O seu domínio é mais evidente na geração de vídeo pura (sem áudio), onde lidera por 57–106 pontos ELO. Nas categorias com áudio integrado, a concorrência está a aproximar-se — as margens são de apenas 2–3 pontos.

A origem da equipa é inesperada. Criado por um grupo que se separou da infraestrutura de I&D de e-commerce da Alibaba, e não por um laboratório de investigação de IA tradicional. Isto sinaliza que equipas de engenharia aplicada podem competir na vanguarda absoluta.

Ainda existem grandes incógnitas. Sem API pública, sem preços, sem artigo técnico e sem especificações confirmadas. A liderança nos benchmarks ainda não significa acessibilidade no mundo real.

Fique atento. Quando a API for lançada, os dados de custo e fiabilidade determinarão se o HappyHorse-1.0 se torna uma ferramenta padrão ou se fica apenas como uma curiosidade de benchmark. Atualizaremos este artigo à medida que surgirem detalhes.

Última atualização: abr de 2026. Dados de benchmark provenientes da Artificial Analysis. Os rankings são dinâmicos e podem mudar à medida que novas avaliações são adicionadas.