¿Qué es HappyHorse-1.0? El desconocido modelo de IA de video que acaba de arrasar en todos los benchmarks principales

Última actualización: abril de 2026

Un modelo que nadie vio venir acaba de llevarse el puesto n.º 1 en los cuatro rankings de generación de video monitoreados por Artificial Analysis, la plataforma de evaluación independiente más citada para IA de video.

Su nombre: HappyHorse-1.0.

No es de Google. Ni de OpenAI. Ni de ByteDance. Proviene de un laboratorio independiente que nació dentro de una empresa de comercio electrónico.

Esto es lo que aprenderás en este artículo en unos 8 minutos: una imagen clara de qué es realmente HappyHorse-1.0, quién lo creó, cómo rinde exactamente frente a sus principales competidores (con tablas de benchmark completas), qué es lo que aún no sabemos y qué significa esto si trabajas con video analítico de IA en cualquier nivel.

Vamos a ello.

HappyHorse-1.0 de un vistazo

HappyHorse-1.0 es un modelo de generación de video por IA que admite:

Síntesis de texto a video

Síntesis de imagen a video

Generación de audio integrada

Fue lanzado en abril de 2026 e inmediatamente alcanzó el primer puesto en todos los rankings de video de Artificial Analysis, algo inédito para un solo modelo.

Lo que lo hace destacar no es una función llamativa, sino su consistencia: HappyHorse-1.0 supera a modelos de ByteDance (Seedance 2.0), KlingAI (Kling 3.0), Google (Veo 3.1), xAI (Grok) y otros, en múltiples tipos de tareas simultáneamente.

Una aclaración rápida: Liderar los benchmarks no convierte automáticamente a un modelo en la mejor herramienta para cada flujo de trabajo. Los benchmarks miden la preferencia humana en comparaciones directas controladas; no miden el tiempo de actividad de la API, el precio o la fiabilidad en casos extremos. Pero cuando un modelo lidera los cuatro rankings basándose en más de 31 000 muestras de evaluación, ya no es ruido. Es una señal que vale la pena entender.

A día de hoy, la API aparece como "Próximamente"; aún no hay acceso al público.

¿Quién creó HappyHorse-1.0?

Aquí está la parte que tomó por sorpresa a la comunidad de IA.

Uno esperaría que el modelo de video mejor clasificado del mundo viniera de un laboratorio de investigación de IA pura con gran financiación. En cambio, HappyHorse-1.0 fue creado por un equipo liderado por Zhang Di, que originalmente operaba dentro del Future Life Lab de Taotian Group.

¿Qué es Taotian Group? Es la entidad detrás de Taobao y Tmall, las plataformas principales de comercio electrónico de Alibaba. El Future Life Lab se creó bajo la División de Innovación ATH-IA, una unidad interna de I+D, y desde entonces se ha escindido como una entidad independiente.

Entonces, ¿es solo el "modelo de video de Alibaba" con otro nombre?

No exactamente. El equipo se ha separado de la organización matriz. Pero su herencia importa: años de acceso a la infraestructura a escala de Alibaba, tuberías de datos y talento de ingeniería claramente sentaron las bases para construir algo de este nivel.

Es un patrón que vale la pena vigilar. En la IA, los competidores más disruptivos a menudo no son los que tienen más investigadores, sino los que tienen el mejor músculo de ingeniería aplicada: equipos que han estado lanzando productos a escala y aportan esa disciplina al desarrollo de modelos.

Piénsalo así: Google DeepMind tiene más de 1000 investigadores. ¿Pero un equipo enfocado de unos 50 ingenieros que han estado construyendo sistemas de recomendación en tiempo real para mil millones de usuarios? Ellos entienden la optimización, la infraestructura y la fiabilidad a un nivel que los laboratorios de investigación pura a veces no alcanzan.

Los Benchmarks: Desglose completo de rendimiento

Ahora, veamos qué pasó realmente en los rankings. Estos son los datos que hicieron que HappyHorse-1.0 fuera imposible de ignorar.

Las clasificaciones a continuación provienen de Artificial Analysis (abril de 2026). Las puntuaciones se basan en el sistema ELO, lo que significa que derivan de comparaciones directas de preferencia humana: personas reales viendo resultados de video uno al lado del otro y eligiendo el mejor.

1. Texto a video (sin audio)

| Puesto | Modelo | Creador | Puntuación ELO | Muestras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1379 | 8819 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1273 | 8426 |

| 3 | SkyReels V4 | Skywork AI | 1245 | 5956 |

| 4 | Kling 3.0 1080p (Pro) | KlingAI | 1242 | 5390 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1230 | 4879 |

Diferencia sobre el n.º 2: +106 puntos ELO.

¿Qué tan grande es eso? En términos de ELO de ajedrez, una diferencia de 100 puntos es más o menos la diferencia entre un jugador fuerte de club y un competidor de nivel nacional. No es cuestión de suerte; es un nivel superior.

2. Imagen a video (sin audio)

| Puesto | Modelo | Creador | Puntuación ELO | Muestras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1413 | 9056 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1356 | 4656 |

| 3 | grok-imagine-video | xAI | 1332 | 6299 |

| 4 | PixVerse V6 | PixVerse | 1318 | 9441 |

| 5 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1298 | 4741 |

Diferencia sobre el n.º 2: +57 puntos ELO.

Esta es la puntuación absoluta más alta de HappyHorse-1.0 (1413) en todas las categorías. La conversión de imagen a video suele ser donde los modelos muestran sus debilidades; mantener la coherencia del movimiento respetando la imagen de origen es técnicamente exigente. Una puntuación alta en I2V sugiere una comprensión espacial robusta.

3. Texto a video (con audio)

| Puesto | Modelo | Creador | Puntuación ELO | Muestras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1225 | 6684 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1222 | 7873 |

| 3 | SkyReels V4 | Skywork AI | 1142 | 5226 |

| 4 | Kling 3.0 Omni 1080p (Pro) | KlingAI | 1108 | 5346 |

Diferencia sobre el n.º 2: +3 puntos ELO.

Mínima. Esto nos dice algo importante: la generación de audio nativa es la nueva frontera competitiva, y ningún modelo se ha despegado todavía. Todos los actores principales están convergiendo aquí.

4. Imagen a video (con audio)

| Puesto | Modelo | Creador | Puntuación ELO | Muestras |

|---|---|---|---|---|

| 🥇 1 | HappyHorse-1.0 | HappyHorse | 1162 | 6896 |

| 2 | Dreamina Seedance 2.0 720p | ByteDance Seed | 1160 | 4831 |

| 3 | SkyReels V4 | Skywork AI | 1084 | 5524 |

| 4 | Veo 3.1 Fast | 1075 | 4680 |

Diferencia sobre el n.º 2: +2 puntos ELO.

Otro empate técnico. Pero el patrón se mantiene: HappyHorse-1.0 es el n.º 1 en todas las categorías.

Analizando el panorama completo

Entonces, ¿qué nos dicen los datos completos?

En calidad de video puro (sin audio): HappyHorse-1.0 tiene una ventaja dominante, entre 57 y 106 puntos ELO por delante. Esta es su zona más fuerte.

En video con audio integrado: La ventaja se estrecha a 2 o 3 puntos. Es una competencia reñida donde todo el campo todavía está madurando.

En los cuatro rankings combinados: Más de 31 000 muestras de evaluación. Esto no es una casualidad en un conjunto de pruebas pequeño.

La conclusión principal de los benchmarks: HappyHorse-1.0 es definitivamente el modelo más fuerte para la generación de video puro, y lidera o compite al más alto nivel en la nueva tarea combinada de audio y video.

HappyHorse-1.0 en acción: Galería de muestras

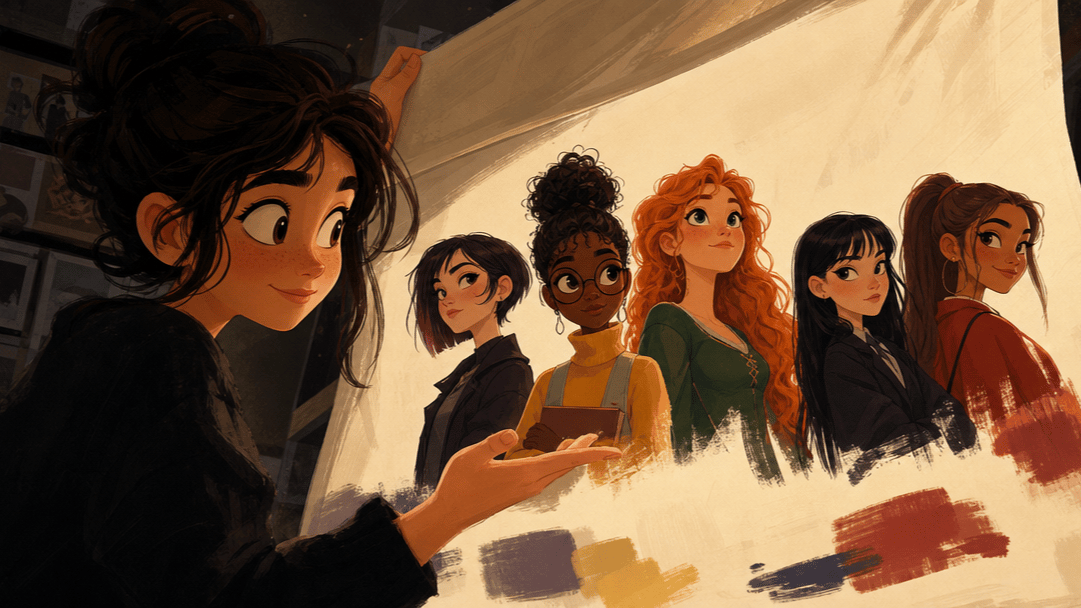

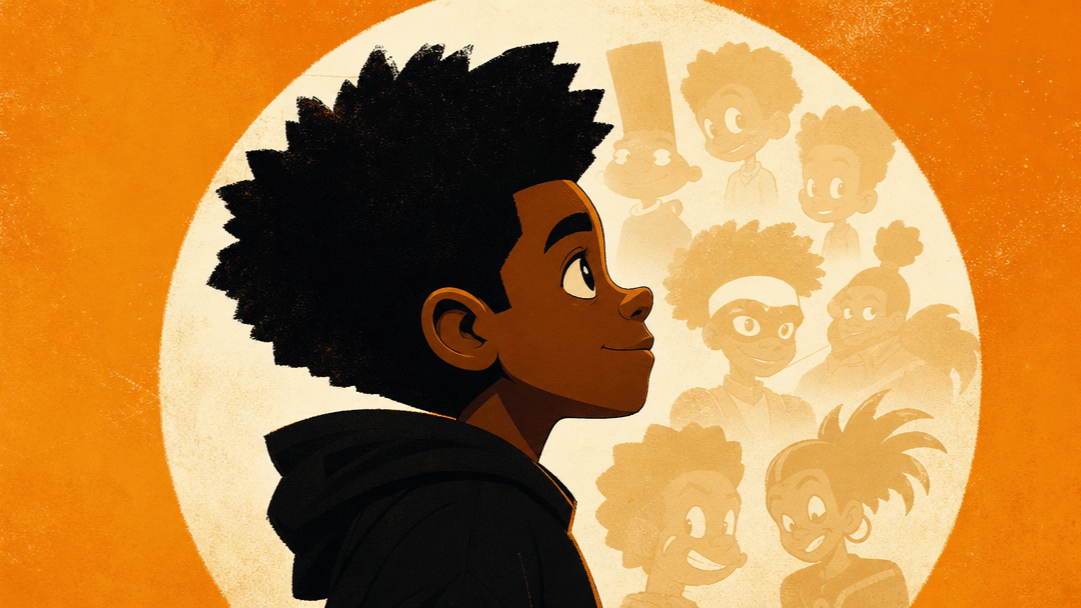

Animación de personajes 3D

Cinematografía fotorrealista

Naturaleza y detalles macro

Emoción y expresión humana

Estilos de anime y dibujos animados

Estilo de vida y comida

Animación de personajes 3D

Cinematografía fotorrealista

Naturaleza y detalles macro

Emoción y expresión humana

Estilos de anime y dibujos animados

Estilo de vida y comida

Lo que aún no sabemos

Los benchmarks son solo una perspectiva. Aquí está lo que falta antes de que alguien pueda llamar a HappyHorse-1.0 la mejor herramienta definitiva:

Aún no hay API pública. Todo lo que tenemos es un "Próximamente". No hay fecha de lanzamiento confirmada.

Sin documento técnico. No se han publicado detalles de la arquitectura, divulgación de datos de entrenamiento o desglose de la metodología.

Especificaciones de resolución y duración: sin confirmar. La resolución máxima, la tasa de fotogramas y la longitud del video no están listadas.

Sin precios. Sin una API activa, es imposible comparar costos con competidores (por ejemplo, SkyReels V4 a ~$7,20/min o video de Grok a ~$4,20/min).

Estado de código abierto: desconocido. No aparece bajo el filtro de "Pesos abiertos" de Artificial Analysis.

Por qué esto importa: Un modelo que obtiene la puntuación más alta pero cuesta 10 veces más o tiene un tiempo de actividad de la API del 50% no dominará el uso en el mundo real. El rendimiento es necesario, pero no suficiente. Actualizaremos este artículo a medida que surjan estos detalles.

Lo que indica HappyHorse-1.0 sobre el mercado de IA de video

Más allá del modelo en sí, la aparición de HappyHorse-1.0 nos dice tres cosas sobre hacia dónde se dirige la industria.

La frontera no está bloqueada por los sospechosos habituales

Google, OpenAI y ByteDance tienen los presupuestos más grandes. Pero el modelo de video n.º 1 acaba de venir de un equipo que se separó del laboratorio de I+D de una plataforma de compras. Si estás construyendo en este espacio —como startup, colaborador de código abierto o equipo de innovación corporativa—, esto debería ser alentador. La puerta está abierta.

El ecosistema de IA de video de China está tomando la delantera

Mira de nuevo el ranking de texto a video. Cuatro de los cinco mejores modelos son de equipos chinos: HappyHorse, ByteDance Seed, Skywork AI, KlingAI. Esto no es una excepción aislada; es un patrón. La capacidad de generación de video con IA de China no es solo competitiva; según los benchmarks actuales, está liderando.

La integración de audio + video es el próximo campo de batalla

Artificial Analysis ahora sigue rankings separados para "con audio" y "sin audio". Esa división existe porque el mercado se está moviendo hacia una generación audiovisual totalmente integrada. Las ligeras ventajas de HappyHorse-1.0 en las categorías de audio sugieren que fue diseñado con este futuro multimodal en mente, pero todos los demás también. Las brechas cambiarán. Esta carrera apenas comienza.

Preguntas frecuentes (FAQ)

Conclusiones clave

HappyHorse-1.0 es el modelo de IA de video n.º 1 actualmente en los cuatro rankings de Artificial Analysis (texto a video e imagen a video, con y sin audio), evaluado en más de 31 000 muestras.

Su dominio es más evidente en la generación de video puro (sin audio), donde aventaja por 57-106 puntos ELO. En las categorías con audio integrado, la competencia se aprieta con márgenes de solo 2-3 puntos.

El origen del equipo es inesperado. Creado por un grupo escindido de la infraestructura de I+D de comercio electrónico de Alibaba, no por un laboratorio de investigación de IA tradicional. Esto indica que los equipos de ingeniería aplicada pueden competir en la frontera absoluta.

Aún quedan grandes incógnitas. No hay API pública, ni precios, ni documento técnico, ni especificaciones confirmadas. Liderar los benchmarks no equivale todavía a accesibilidad en el mundo real.

No lo pierdas de vista. Cuando se lance la API, los datos de costo y fiabilidad determinarán si HappyHorse-1.0 se convierte en una herramienta estándar o se queda en una curiosidad de los rankings. Actualizaremos este artículo cuando surjan más detalles.

Última actualización: abril de 2026. Datos de benchmark obtenidos de Artificial Analysis. Las clasificaciones son dinámicas y pueden cambiar a medida que se añaden nuevas evaluaciones.